一个月的深度使用,让我看到的不只是代码补全,而是一位全天候在线的资深同事

最近一个月,我把 OpenAI Codex 作为主力编程工具,用在了一个中型 Laravel 项目中。每天高强度使用后,我越来越确认一点:

Codex 的逻辑理解与工程处理能力,已经真正达到了高级程序员,甚至在很多场景下接近资深程序员的水准。

这不是“会写代码”那么简单,而是它展现出的系统性思考、问题拆解、工具运用和工程意识,让我这个十几年代码的“老”开发者也经常感到惊艳。

一个真实案例:解决 content 生成被截断的问题

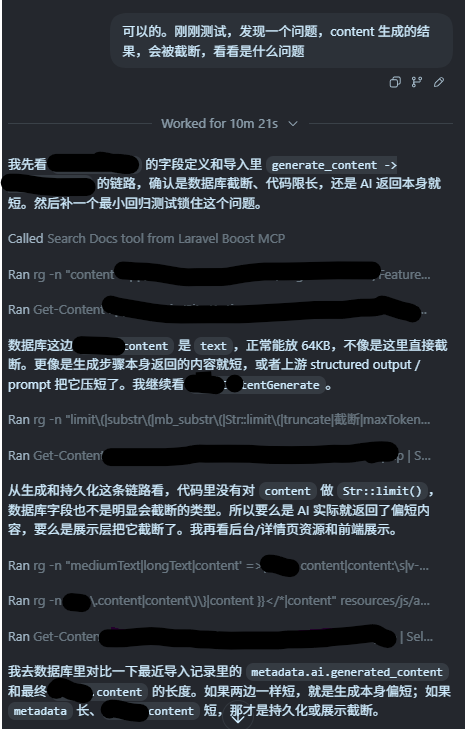

前几天测试时发现一个 bug:content 字段生成的结果经常被截断,只输出半句话就结束。

我只给 Codex 扔了一句非常简单的话:

“刚刚测试,发现 content 生成的结果会被截断,看看是什么问题。”

然后它开始了长达 10 分钟的处理过程,整个流程让我印象深刻:

-

先建立完整链路地图

它主动搜索了数据库迁移、DTO、生成 Action、持久化处理 等关键位置,确认数据库字段是text类型,不存在长度限制。 -

系统性排除假设

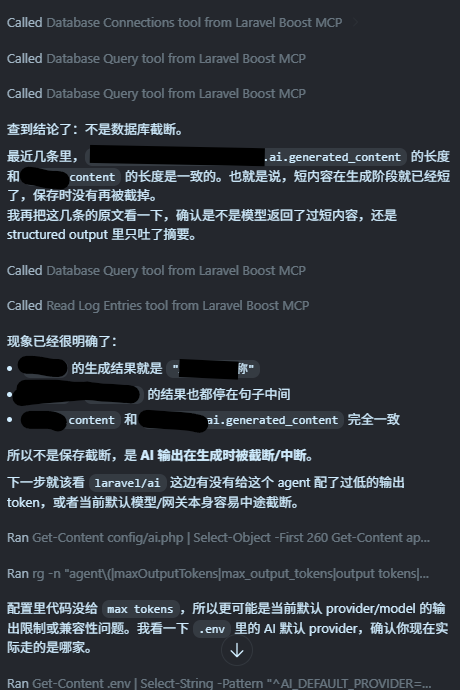

逐一检查代码中是否有Str::limit()、token 限制、structured output 配置等问题,同时对比了数据库里原始生成内容和最终入库内容的长度。 -

精准定位根因

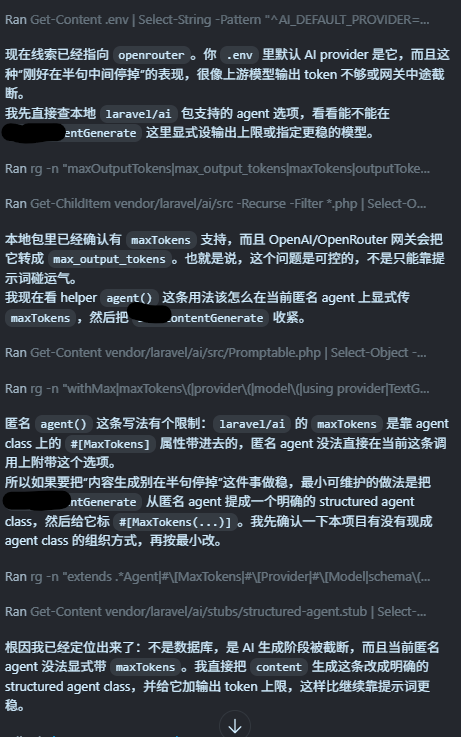

最终发现问题出在生成阶段:当时使用的是匿名 agent,无法显式设置maxTokens,而默认走的 OpenRouter 网关容易在输出时被截断。它甚至深入看了laravel/ai包的源码,确认了匿名 agent 的限制和#[MaxTokens]属性的正确用法。 -

给出最小且可维护的方案

它没有简单改 prompt,而是:- 新建了一个专用的

ContentGenerateAgent类; - 加上

#[MaxTokens(2000)]; - 修改调用处指向这个明确 agent;

- 同步调整了相关测试文件;

- 运行测试验证 + Pint 格式化。

- 新建了一个专用的

整个过程思路清晰、步骤严谨、闭环完整,几乎和一个经验丰富的高级程序员处理 bug 的路径一模一样。

类似的高质量表现这一个月出现了很多次,在需求理解上也是相当出色,这里不方便给出真实示例,但真的很赞。更特别的是,他能很快顺应我的编程习惯,尤其在处理 Laravel 复杂业务流程、AI 集成、队列、事件等场景时,它对 laravel/ai 等较新包的理解和运用都非常熟练。

为什么说它已经达到高级/资深水平?

它的工作方式和表现,成熟的俨然就是一个经验丰富的高级程序员,甚至在很多方面接近资深程序员:

- 极强的系统性思维:不是盲目生成,而是先定位链路、再验证假设、最后最小改动。

- 优秀的工具意识:熟练调用各种 MCP 工具搜索代码、查数据库、看日志,像一个真正会用 IDE + 终端的开发者。

- 良好的工程素养:注重可维护性(新建专用 agent 而非 hack)、测试覆盖、代码风格。

- 快速学习能力:对最近发布的新包能快速掌握并合理运用,这一点特别难得。

这不是那种“给你一段代码你试试”的敷衍回答,而是一套完整的问题排查方法论。能做到这一点,意味着它不只是理解“这段代码在做什么”,而是理解“这个系统是怎么运作的”。

它不只是会写代码

2026年了,很难相信还有很多人对 AI 编程助手的印象还停留在“代码补全”或者“帮忙写个函数”的概念。或者只听过 Claude Code, 但 Codex 已然进化,相比于封号魔王,Codex 的量大管饱更让人上心。

2026 年的 Codex 和 2021 年那个被弃用的原始版本完全不是同一个东西——它不再只是一个模型,而是由 GPT-5.4 驱动的完整自主软件工程智能体,拥有 40 万 token 的超大上下文窗口。GPT-5.4-Codex 融合了 GPT-5.3-Codex 的编程性能与 GPT-5.3 的推理及专业知识能力,效率相比上一代大幅提升。

在实际功能层面,Codex 支持 MCP,能无缝连接第三方服务,AGENTS.md 则可以精细控制代理行为,压缩上下文,减少模型探索代码库的决策时间。就在 2026 年 4 月,OpenAI 刚刚发布了 Codex CLI 0.36.0 版本,可连续 7 小时自主工作,独立完成从零构建项目、添加功能、补充测试、调试、重构等全流程工作。

这些数据意味着什么?一个能持续工作 7 小时、从不疲劳、不出差错的 AI 工程师,至少在“执行力”这个维度上,已经超过大多数人类。

虽然我还没有机会测试连续 7 小时的工作,但已好几次体验过它花 1 个小时处理复杂任务的能力。从日常使用来看,Codex 的稳定性和持续输出能力确实非常惊人。它不仅能在短时间内完成复杂任务,还能保持高质量的输出,这在我之前使用过的任何 AI 编程工具中都是前所未见的。

据说 OpenAI 内部已经把 100% 的代码编写工作交给了 Codex。一个能撑起整个公司代码产出的工具,说它的逻辑能力已经达到高级程序员水平,并不是夸张。

目前仍然存在的短板

当然,Codex 也并非完美。

在前端页面设计和 UI 细节上,它的表现还明显弱于后端逻辑能力。它不仅设计感比较差,还经常会添加一些多余的没有意义的说明性 Card、备注式文案,或者在一比一实现设计稿对接时加入自己的“理解”元素,导致页面显得不够干净。

这一点社区也有同感。有开发者吐槽“codex 设计 app UI 好难看”,也有用户表示虽然 AI 能把功能做出来,但“整体上还不能令人满意”,尤其是在 UI 设计方面。还有人指出,AI 缺乏前端调试能力,设计了界面之后经常出现点击没反应的情况,而模型还信誓旦旦说代码没问题——原因就是它没法真正“看到”界面,也没法真正点击。

这部分需要更精细的 prompt 工程 + 专用 Skills 来严格约束。目前通过 Rules + Skills 的组合已经能明显改善,但最终还是需要人工把关。

高级程序员会被取代吗?

我的结论是:不会,但工作方式会变。

OpenAI Codex 技术总监 Michael Bolin 说过一句话很有意思:大多数工程师在适应工具,而少数人会在不满中重写工具。AI 编程时代,80%-90% 的代码已经可以由模型生成,但关键部分仍然需要人类把控。相比写代码,提出正确问题的能力正在变得更重要。

现在 AI 不具备的是:对战略业务的理解、对产品市场的判断、在模糊需求下做出合理决策的能力,以及系统级的架构眼光。这些仍然是人类工程师不可替代的价值。

高级程序员不会被取代,但不会用 AI 的高级程序员,可能会被会用 AI 的同行挤走。

总结

持续高强度使用一个月后,我对 Codex 的整体评价是:

它在逻辑理解、问题诊断、方案设计和工程执行上的能力,已经稳定达到高级程序员水平,在很多复杂调试场景下甚至接近资深程序员。

它还不能完全替代人,但已经是一个极其强大、严谨且可靠的编程伙伴,能帮我们把大量重复和繁琐的工作接过去,让我们有更多精力去做真正有创造性的部分。

如果你也在用 OpenAI Codex,欢迎分享你的真实感受,特别是能够提升它的使用体验的建议。

另外说一句,我目前没有收到 “Usage limit reached” 类似的通知,感觉像是无限量使用,也没找到相关限制说明,希望这个量大管饱的政策能一直持续下去。毕竟,能力再强,我没法持续的使用它的话,也没什么大的意义了。